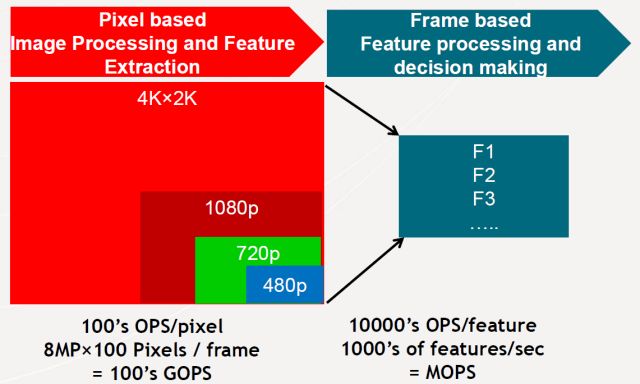

典型的嵌入式视觉系统必须处理视频帧,从这些处理的帧中提取特性,然后根据所提取的特性来决定下一步的动作。在你谈论高清或4K2K视频时,基于像素的任务中每个像素可能需要数百个操作,并且需要数百个GOPS(千兆运算/秒)。 相比之下,基于帧的任务,每秒“仅”需要百万次的操作,但是算法更加复杂。你需要一个硬件实现像素级任务,同时快速处理器能够处理更复杂的“基于帧”的任务。

Avnet的技术营销工程师Mario Bergeron在上周美国加州圣克拉拉举办的嵌入式视觉峰会2015 上对此做了一个演讲。

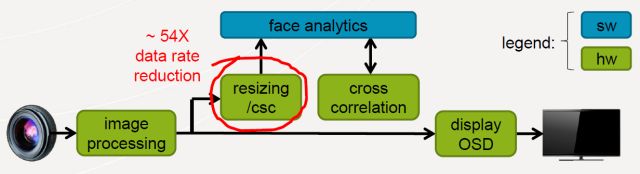

Bergeron演示了一个脸部识别和视线跟踪应用的幻灯片,其通过采用针对赛灵思全可编程器件的Xylon公司 LogicBricks IP实现的, 他还展示了系统如何分配硬件和软件之间的应用任务,如下图所示。

一个重要的因素要注意:在将其发送到微处理器之前,硬件减少了54x的图像数据率。

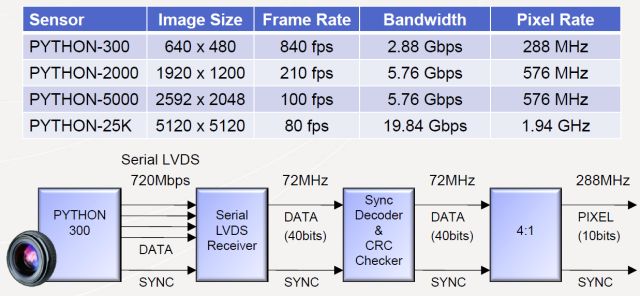

在Bergeron 演讲中提到的一个最有趣的点是嵌入式视觉设计者所必须要处理的范围广泛的接口。Bergeron展示了一个安森美半导体的PYTHON图像传感器系列中4个图像传感器的幻灯片。传感器系列包括了这类器件,其图像大小范围从640x480像素 到5120x5120像素,帧速率范围从80到840帧/秒,和多个LVDS I/ O引脚的带宽要求范围从2.88到19.84Gbps。 制作一个可以处理这类图像传感器系列中所有传感器的硬件是很难的,但是交由赛灵思全可编程器件联合 XYLON 和 Auviz Systems厂商的现成IP核来处理就会很容易。

Bergeron 提到的另一个工具是针对赛灵思Zynq SoCs 和MPSoCs 的全新SDSoC开发环境,该开发环境提供了以软件为中心,系统级优化的编译器,其可以接受使用C或C++编写的系统描述,同时能自动生成实现所描述系统所需要的软件应用和硬件配置。该SDSoC开发环境采用软件编译器、HLS(高层次综合)和预设的硬件基础设施来搭建这样的系统。

当天晚些时候,Bergeron在与嵌入式视觉峰会相连的展览会上的Avnet平台中展示了上述描述的应用。演示展示了实时运行在赛灵思Zynq SoC上的脸部识别应用,在MicroZed SOM (系统模块)上插入了一个特别的载卡。同时, MicroZed SOM和载卡构成Avnet嵌入式视觉开发套件,它可以接受来自多个供应商的图像。

该套件以及Xylon面部识别与视线追踪IP在3月份的VisionChina 2015展会上也有展示,以下是视频演示:

原文链接:http://forums.xilinx.com/t5/Xcell-Daily-Blog/Do-you-need-to-handl......

© Copyright 2014 Xilinx Inc

如需转载,请注明出处